Einstufung von Verbatims in Ebene 1 und 2: Tutorial

Verfasst von

Matthieu SAUSSAYE

Veröffentlicht

Offene Verbatims (Level 1 und 2) mit smartinterivew klassifizieren

Sobald die Daten erhoben wurden, sei es über SmartInterview oder eine externe Datei, ist der nächste Schritt, offene Antworten in nutzbare thematische Codes umzuwandeln.

Smartinterview ermöglicht:

Einen Codierungsplan zu definieren (1 oder 2 Tiefenebenen) (bald 3)

Themen automatisch per KI zu generieren, mit benutzerdefinierten Anweisungen

Die Anzahl der Codes pro Befragtem dank eines Regelsystems präzise zu steuern

Einen Trainingsdatensatz zu importieren, um die Klassifizierung zu steuern

Eine Stichprobe vorzuklassifizieren und Ergebnisse zu korrigieren

Die vollständige Klassifizierung über alle Antworten zu starten

Die Qualität der Codes mit einer MECE-Korrelationsmatrix zu bewerten (mutually exclusive, collectively exhaustive)

Ergebnisse nach Excel zu exportieren

Ergebnisse im Dashboard zu analysieren

Dieser Artikel erklärt, Schritt für Schritt, wie man in der Plattform eine Klassifizierung mit 1 oder 2 Ebenen durchführt.

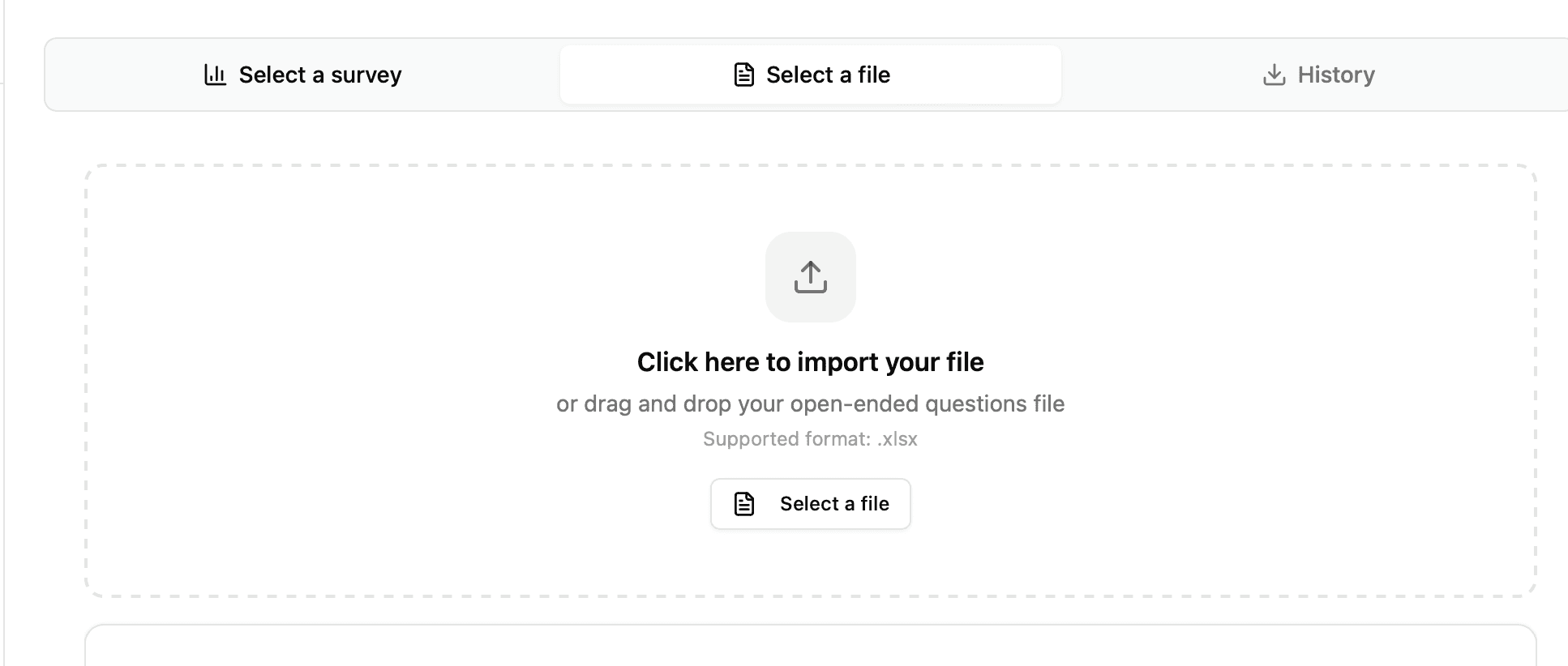

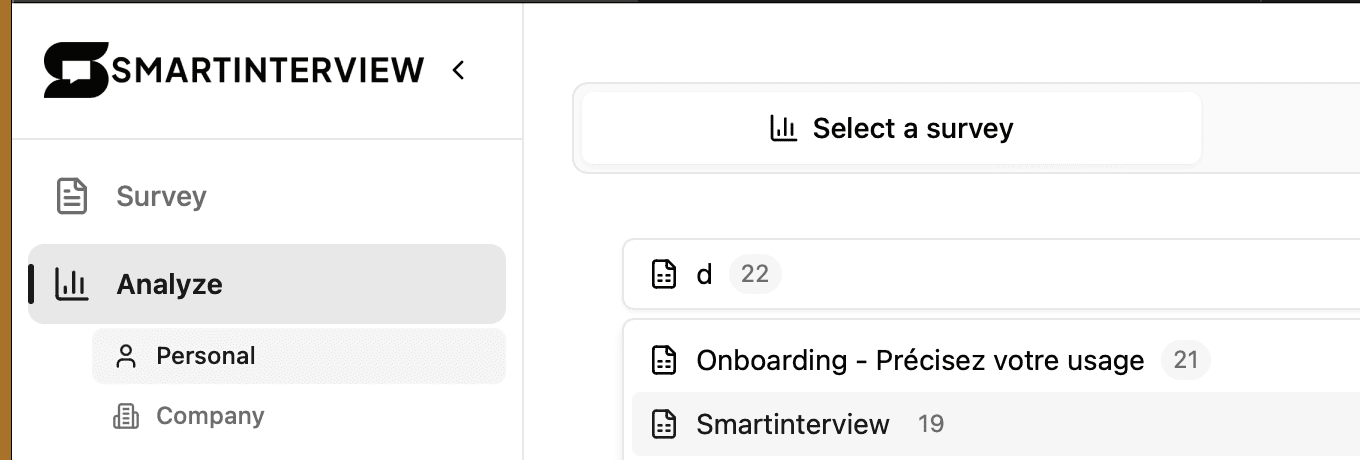

1. Datenquelle auswählen

Die Codierung akzeptiert zwei Quellen :

Quelle | Verwendung | Wann verwenden |

|---|---|---|

SmartInterview-Umfrage | Wählen Sie eine bestehende Umfrage und anschließend eine offene Frage aus | Sie haben Antworten über SmartInterview erhoben |

Excel-Datei | Importieren Sie eine Datei mit den Verbatims | Sie haben Daten aus einem externen Tool |

Excel-Datei:

Umfrage:

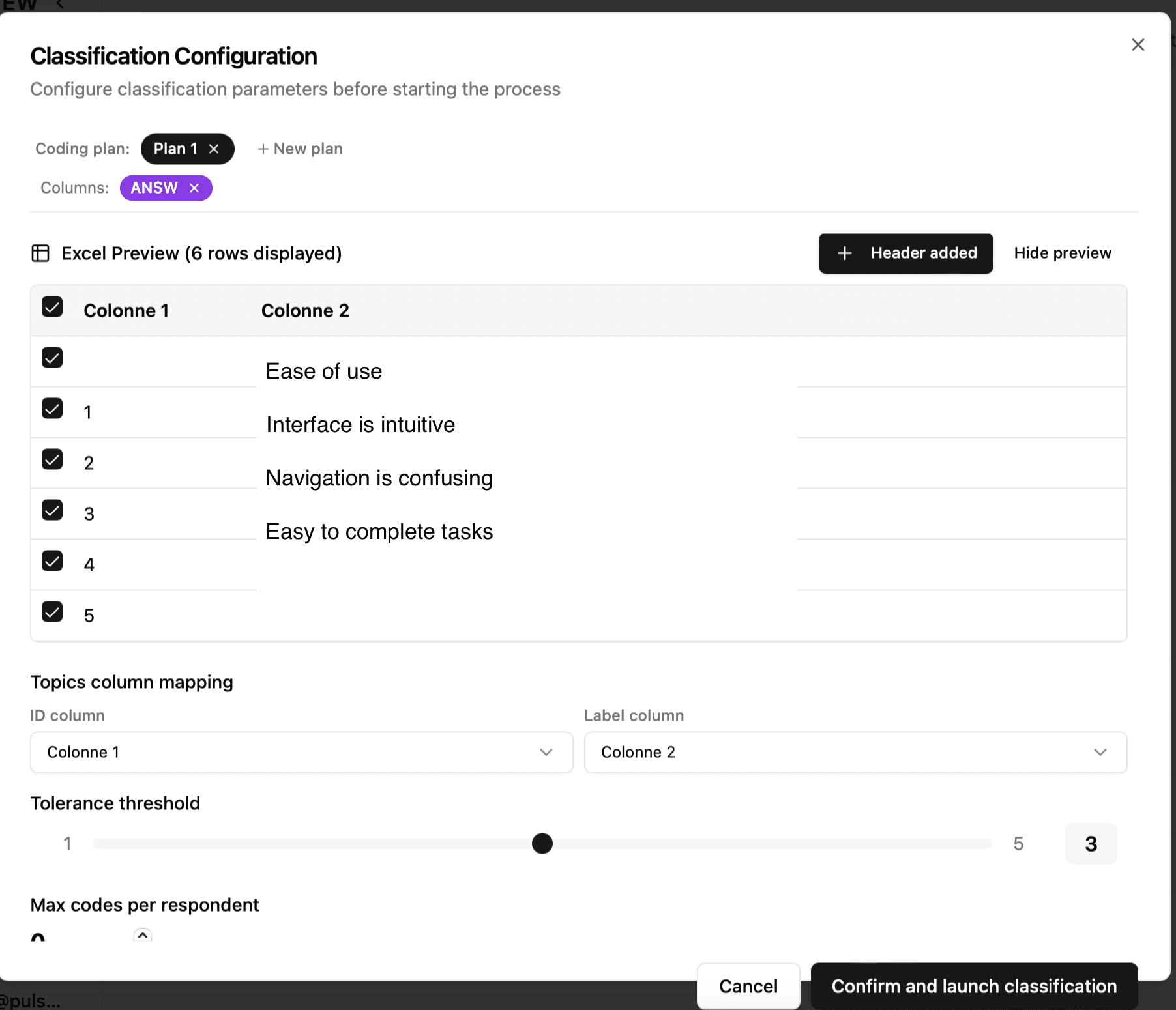

Dateiimport: Spaltenauswahl

Beim Import einer Datei müssen Sie dem System angeben :

Die Befragten-Spalte (eindeutige Kennung jedes Befragten)

Wenn Ihre Datei keine Kennung enthält, wählen Sie "No column" : das System nummeriert die Befragten automatisch von 1 bis N

Die Antwortspalte zur Klassifizierung (die Verbatims)

Tipp : Das System erkennt gängige Spalten automatisch (Respondent_ID, Serial, Réponses, Answer, usw.) anhand der Datei-Header.

[Screenshot: Spaltenauswahl in der Konfiguration]

2. Klassifizierungstiefe wählen

Tiefe 1 Ebene (nur L1)

Eine flache Liste mit Hauptthemen. Jede Antwort wird einem oder mehreren Themen zugeordnet.

Use Case : explorative Studien, schnelle Erstanalyse, kurze Verbatims.

Tiefe 2 Ebenen (L1 + L2)

Hauptthemen (L1) mit zugehörigen Sub-Themen (L2). Die Struktur ist hierarchisch : jedes Sub-Thema gehört genau zu einem Parent-Thema.

Use Case : tiefgehende Studien mit feiner Granularität, Differenzierung von Nuancen innerhalb desselben Themas, Codierungen nach market research standards.

In diesem Beispiel:

Ease of use → L1 (Hauptthema)

Zeilen mit einer ID → L2 (Sub-Themen)

3. Codierungsplan definieren

Sie haben außerdem zwei Möglichkeiten, Ihren Codeplan zu erstellen :

A - Einen Excel code-frame importieren (wie im Beispiel)

B - Die KI die Themen generieren lassen.

Option A: Codes per Excel importieren

Wenn Sie bereits über einen code-frame verfügen, importieren Sie ihn direkt.

Format für 1 Ebene

Eine Datei mit mindestens einer Spalte, die die Themenlabels enthält :

ID | Label |

|---|---|

1 | Interface is intuitive |

2 | Ease of use |

3 | Performance is fast |

4 | App crashes |

5 | Nothing |

Format für 2 Ebenen

Die Datei muss L1 und L2 hierarchisch strukturieren. Das System erkennt die Spalten ID und Label automatisch anhand der Header.

Option 1 : Getrennte Ebenenspalten (in einem Excel-Sheet):

L1 | L2 |

|---|---|

Ease of use | Interface is intuitive |

Ease of use | Navigation is confusing |

Ease of use | Easy to complete tasks |

Ease of use | Sensation is smooth |

Ease of use | The shape is nice |

Option 2 : Mit Kennungen und Parent_ID :

💡 Tipp : Sie müssen die Topics in einem separaten Sheet Ihrer Excel-Datei speichern (z. B. ein Tab "Topics"). Das System schlägt Ihnen vor, das Sheet mit den Codes auszuwählen.

Vorschau und Filterung

Nach dem Import wird eine Vorschau des code-frame angezeigt mit :

Der Anzahl erkannter Topics (automatisch aktualisiert)

Der Möglichkeit, nach Spalte zu filtern (nützlich, um bestimmte Kategorien auszuschließen)

Der Möglichkeit, einzelne Zeilen manuell auszuschließen

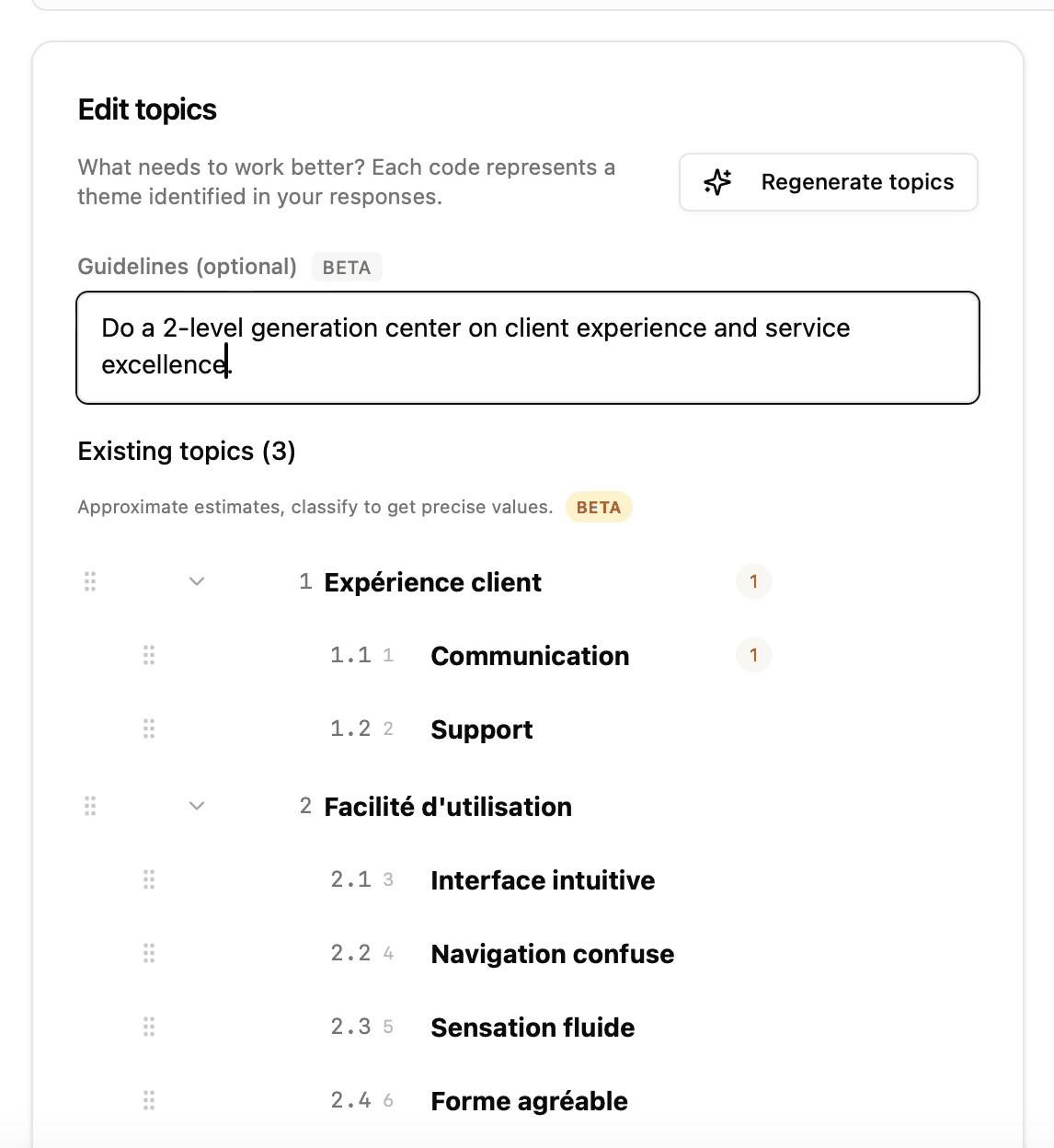

Option B: Codes per KI generieren

Wenn Sie keinen bestehenden Codeplan haben, analysiert die KI eine Stichprobe Ihrer Antworten und erkennt wiederkehrende Themen automatisch.

Wie es funktioniert

Das System zieht eine Stichprobe von bis zu 400 Antworten aus Ihrer Datei

Die KI identifiziert wiederkehrende Themen und formuliert sie als klare Labels

Die Themen werden nach geschätzten Häufigkeiten sortiert (indikative Anzahl betroffener Befragter)

Die Themen werden automatisch nummeriert (sequenzielle IDs)

Benutzerdefinierte Anweisungen geben (Guidelines)

Sie können die Generierung steuern, indem Sie Textanweisungen im Feld "Guidelines" angeben:

Diese Anweisungen beeinflussen direkt :

Das verwendete Vokabular für die Labels

Das Granularitätsniveau (mehr oder weniger Themen)

Die Analyseperspektive (sensorisch, emotional, funktional...)

Die Sprache der Labels

⚠️ Wichtig : Die Anweisungen sind in der Beta-Version. Sie funktionieren gut zur Steuerung der Generierung, aber die Ergebnisse können variieren. Prüfen Sie die generierten Themen immer.

Generierung im 2-Ebenen-Modus

Im 2-Ebenen-Modus umfasst der Prozess zwei Schritte :

Generierung der L1: Die KI identifiziert die Hauptthemen

Automatische Generierung der L2: Für jedes L1-Thema erzeugt die KI automatisch Sub-Themen auf Basis der entsprechenden Antworten

L1-Themen, die noch keine Sub-Themen haben, werden automatisch erkannt, und das System startet die Generierung der fehlenden L2, bevor die Klassifizierung beginnt.

Themen-Editor

Ob importiert oder generiert, die Themen erscheinen im Themen-Editor (linkes Seitenpanel), wo Sie :

Aktion | Wie |

|---|---|

Ein Thema umbenennen | Klicken Sie auf das Label und bearbeiten Sie es direkt |

Ein Thema löschen | Klicken Sie auf das Papierkorb-Symbol 🗑️ |

Ein Thema hinzufügen | Klicken Sie auf den + Button unten in der Liste |

Themen neu anordnen | Per Drag-and-drop über den Griff ≡ |

L2 auf-/zuklappen | Klicken Sie auf den Pfeil ▶ neben einem L1-Thema |

Themen neu generieren | Klicken Sie auf den ✨-Button, um die KI-Generierung neu zu starten |

L2 eines Parents neu generieren | Klicken Sie auf ✨ neben einem spezifischen L1-Thema |

💡 Die geschätzten Häufigkeiten (indikative Zahl neben jedem Thema) werden nach jeder Klassifizierung neu berechnet. Vor der ersten Klassifizierung stammen sie aus der KI-Schätzung bei der Generierung.

4. Klassifizierungsregeln konfigurieren

Regeln steuern, wie viele Codes jedem Befragten zugewiesen werden können. Sie werden auf drei Ebenen angewendet : bei der Vor-Klassifizierung, auf importierte Beispiele, und bei der vollständigen Klassifizierung.

Regeln für 1 Ebene

Parameter | Beschreibung | Standard |

|---|---|---|

Max codes | Maximale Anzahl Themen pro Befragtem | 0 (unbegrenzt) |

Beispiel : Mit Max codes = 3 kann ein Befragter höchstens 3 Themen erhalten, auch wenn seine Antwort mehr erwähnt.

Regeln für 2 Ebenen

Im 2-Ebenen-Modus ermöglichen drei ergänzende Parameter eine feine Steuerung :

Parameter | Interner Code | Beschreibung | Standard |

|---|---|---|---|

Max L1 | maxCodesL1 | Maximale Anzahl Hauptthemen pro Befragtem | 0 (unbegrenzt) |

Max L2 | maxCodesL2 | Maximale globale Anzahl Sub-Themen pro Befragtem | 0 (unbegrenzt) |

Max L2 pro L1 | maxCodesL2PerL1 | Maximale Anzahl Sub-Themen pro Parent-Thema | 0 (unbegrenzt) |

Reihenfolge der Regelanwendung:

Max L1 : Begrenzt die Anzahl der Hauptthemen (Pass 1)

Max L2/L1 : Begrenzt Sub-Themen pro Parent (Pass 2, per Aufrufe)

Max L2 global : Endgültige Obergrenze nach Zusammenführung aller Sub-Themen (Post-Processing)

💡 Hinweis : Max L2/L1 ist besonders nützlich, wenn manche L1-Themen sehr breit sind und sonst alle Sub-Themen dominieren würden. Zum Beispiel mit Max L2/L1 = 2 kann jedes Parent-Thema höchstens 2 Sub-Themen beitragen, was für eine ausgewogene Verteilung sorgt.

5. Trainingsdatensatz importieren (historische Daten) (optional)

Warum Beispiele importieren?

Ein Trainingsdatensatz (oder few-shot examples) ermöglicht es, Beispiele bereits codierter Verbatims zu zeigen. Diese Beispiele werden als Kontext gesendet, um jeden Klassifizierungsbatch zu steuern.

Der Import wird empfohlen, wenn:

Die Themen nuanciert oder eng beieinander liegen.

Sie Kontinuität innerhalb eines Projekts oder zwischen mehreren Projekten wünschen.

Sie spezifische Codierungskonventionen haben (z. B.: bestimmte Ausdrücke sollen immer unter einem bestimmten Thema klassifiziert werden)

Sie eine bestehende Klassifizierung auf neue Daten reproduzieren möchten.

Die Vor-Klassifizierung ohne Beispiele unbefriedigende Ergebnisse liefert.

Format der Trainingsdatei

Die Excel-Datei muss wie folgt aufgebaut sein :

Answer | ANSW_1aCOMM1 | ANSW_2aCOMM2 | ANSW_3aCOMM3 | ANSW_4aCOMM4 | ANSW_5aCOMM5 |

|---|---|---|---|---|---|

L’interface reste fluide du début à la fin, très proche d’une application premium. | 21 | ||||

L’application est correcte, rien de particulièrement remarquable. | 18 | 207 | |||

Navigation très douce, quelques animations agréables | 18 | 207 | |||

Parfois un peu saccadé et certaines sections semblent mal optimisées. | 45 | 212 | 233 | 240 |

Das System erkennt automatisch Spalten mit Codes, indem es sie mit den im Codierungsplan definierten Themen abgleicht. Spalten, deren Werte bekannten Themen entsprechen, werden automatisch identifiziert.

⚠️ Limit : 30 Beispiele werden gespeichert. Die Codes müssen mit denen übereinstimmen, die im ursprünglichen Codeplan der neu importierten Dateien verwendet werden.

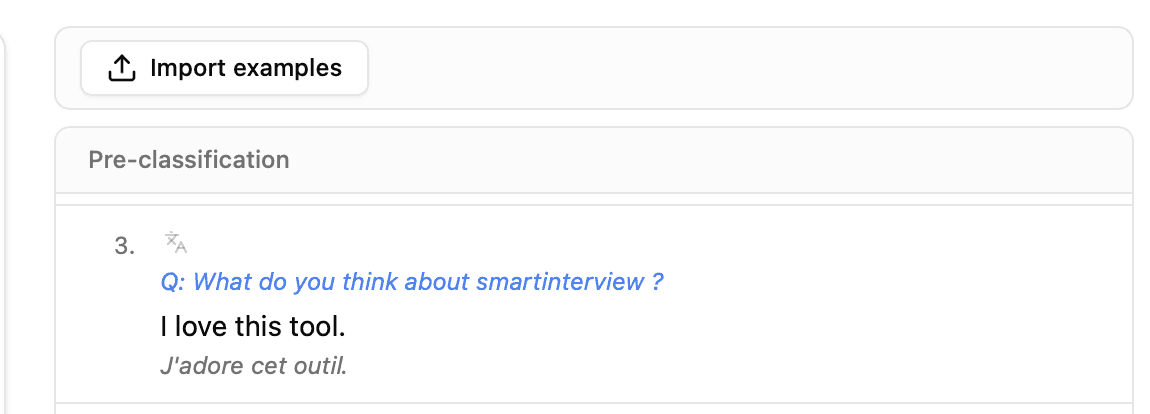

Prüfung und Übersetzung

Jedes importierte Beispiel wird angezeigt mit :

Dem Antworttext (Verbatim)

Den zugewiesenen Themen-Badges (mit Farbcodierung)

Einem individuellen Übersetzungsbutton mit Sprachauswahl (Français, English, Deutsch)

Die Übersetzung ermöglicht die Prüfung des Inhalts der Beispiele in Ihrer Arbeitssprache, ohne die an die Klassifizierung gesendeten Daten zu ändern.

6. Eine Stichprobe vor-klassifizieren

Was ist Vor-Klassifizierung?

Bevor die Klassifizierung auf den gesamten Datensatz angewendet wird, klassifiziert das System testweise die ersten 30 Antworten. Dies ist der wichtigste Schritt, um die Qualität Ihres Codierungsplans zu validieren.

Die Vor-Klassifizierung nutzt exakt denselben Algorithmus wie die vollständige Klassifizierung, aber auf einer kleineren Stichprobe für eine schnelle Prüfung.

Was Ihnen die Vor-Klassifizierung zeigt

Für jede Antwort sehen Sie :

Den Verbatim-Text (mit Hervorhebung von Keywords, die den Themen entsprechen)

Zugewiesene L1-Badges (mit Farbcodierung)

Zugewiesene L2-Badges (wenn Tiefe = 2), unter ihren L1-Parents gruppiert

Eine Zusammenfassung : Anzahl klassifizierter Antworten insgesamt

Ergebnisse korrigieren

Die Vor-Klassifizierung ist interaktiv: Sie können jede Zeile korrigieren :

Aktion | Geste | Effekt |

|---|---|---|

Ein Thema entfernen | Klicken Sie auf das Badge × | Das Thema wird von dieser Antwort entfernt |

Ein L1-Thema hinzufügen | Klicken Sie auf + neben den L1-Badges | Dropdown mit allen verfügbaren L1-Themen |

Ein L2-Thema hinzufügen | Klicken Sie auf + neben den L2-Badges | Gefiltertes Dropdown: Es werden nur Sub-Themen bereits zugewiesener L1 angeboten |

Ein Thema suchen | Tippen Sie in das Suchfeld des Menüs | Echtzeit-Filterung der verfügbaren Themen |

💡 Validierungsbereich : Alle Zeilen zwischen Ihrer ersten und letzten Korrektur gelten als validiert. Sie werden blau markiert und werden automatisch zu für die vollständige Klassifizierung.

7. Vollständige Klassifizierung starten

Wann die Klassifizierung starten?

Starten Sie die vollständige Klassifizierung, wenn :

Die Themen der Vor-Klassifizierung Ihren Erwartungen entsprechen

Mögliche Korrekturen in den ersten 30 Zeilen vorgenommen wurden

Trainingsdaten importiert wurden.

Die Regeln (Max codes) korrekt konfiguriert sind

Was im Hintergrund passiert

Die Antworten werden in Batches aufgeteilt

Jeder Batch wird mit Folgendem an die KI gesendet:

Die Liste der verfügbaren Themen

Die Trainingsbeispiele (importiert + Korrekturen aus der Vor-Klassifizierung)

Die konfigurierten Regeln für Limits

Im 2-Ebenen-Modus:

Pass 1 : L1-Klassifizierung über alle Batches

Pass 2 : Für jedes zugewiesene L1-Thema L2-Klassifizierung pro Parent

Post-Processing : Anwendung der globalen L2-Obergrenze (

Max L2)

Ergebnis

Nach der Klassifizierung sehen Sie :

Einen Erfolgsbanner : "Classification complete : N classified responses"

Die ersten 30 Antworten mit ihren zugewiesenen Codes (bearbeitbar)

Die importierten Beispiele (ausklappbarer Bereich, wenn ein Trainingsdatensatz verwendet wurde)

Die Korrelationsmatrix (siehe nächsten Abschnitt)

8. Ergebnisse mit der Korrelationsmatrix bewerten

Das MECE-Prinzip

Ein hochwertiger Codierungsplan muss MECE sein:

Mutually Exclusive : Jedes Thema deckt einen eigenständigen Aspekt ab. Zwei Themen sollten nicht dasselbe beschreiben.

Collectively Exhaustive : Die Gesamtheit der Themen deckt alle Antworten ab. Kein Verbatim sollte ohne passenden Code bleiben.

Die Co-Occurrence-Matrix lesen

Die Matrix zeigt den Prozentsatz der Befragten, die gleichzeitig zwei Themen erhalten haben. Die Diagonale ist immer 100% (ein Thema ist immer mit sich selbst korreliert).

Interface is intuitive (122) | App is fast (6) | Navigation is confusing. (14) | App crashes or freezes (28) | |

|---|---|---|---|---|

Interface is intuitive (122) | 100% | 33% | 21% | 0% |

App is fast (6) | 33% | 100% | 0% | 0% |

Navigation is confusing (14) | 21% | 0% | 100% | 0% |

App crashes or freezes (28) | 0% | 0% | 0% | 100% |

Wie die Matrix zu interpretieren ist

Signal | Wert | Bedeutung | Empfohlene Aktion |

|---|---|---|---|

🔴 Hohe Korrelation | 50% | Die beiden Themen überlappen häufig: möglicherweise redundant | Themen zusammenführen oder Definitionen präzisieren |

🟠 Mittlere Korrelation | 20-50% | Themen sind verwandt, aber unterscheidbar: akzeptabel | Einige Antworten prüfen, um zu bestätigen |

🟢 Niedrige Korrelation | < 20% | Themen sind gut mutually exclusive | Keine Änderung nötig |

⚪ Null-Korrelation | 0% | Themen treten nie gemeinsam auf | Perfekt für antagonistische Themen (z. B. "Nothing" vs die anderen) |

⚠️ Kleine Fallzahl | (1-2) | Das Thema betrifft sehr wenige Befragte | Möglicherweise zu spezifisch – eventuell mit einem Parent-Thema zusammenführen / oder in einer 1-Level-Codierung entfernen |

💡 Stark korrelierte Zellen werden farblich hervorgehoben, um Probleme schnell zu erkennen.

Analysebeispiel

In der obigen Matrix :

App is fast × Interface is intuitive = 33% → Diese beiden Empfindungen werden manchmal zusammen genannt. Das ist normal für ein per Inhalation konsumiertes Produkt: die Themen bleiben dennoch unterschiedlich.

Nothing × alles andere = 0% → Perfekt: Befragte ohne Aussage werden nicht in andere Themen klassifiziert.

Interface is intuitive (122) ist das dominante Thema: 122 Befragte von 232, also mehr als die Hälfte.

Auf die Ergebnisse reagieren

Wenn die Matrix Probleme aufzeigt :

Klicken Sie auf "Back to codes" , um zum Themen-Editor zurückzukehren

Führen Sie redundante Themen zusammen oder formulieren Sie mehrdeutige Definitionen neu

Starten Sie die Klassifizierung erneut; Korrekturen aus den ersten 30 Zeilen bleiben als Trainingsbeispiele erhalten (Button "Re-classify with corrections")

Dieser iterative Zyklus klassifizieren → bewerten → anpassen → neu klassifizieren ermöglicht es, schrittweise einen robusten und MECE-konformen Codierungsplan zu erreichen.

9. Ergebnisse exportieren

Sobald die Klassifizierung validiert ist, klicken Sie auf "Download Excel" , um eine strukturierte Datei zu erhalten :

Sheet | Inhalt | Beschreibung |

|---|---|---|

FilesQO | Klassifizierte Daten | Jeder Befragte mit Text und zugewiesenen Codes (L1- und L2-Spalten falls zutreffend) |

Topics | Codierungsplan | Vollständige Liste der Themen mit ihren IDs, hierarchisch organisiert |

Top Topics | Häufigkeitsübersicht | Die häufigsten Themen mit ihren Counts und Prozentwerten |

Praktische Tipps

Wie viele Themen definieren?

Anzahl Antworten | Empfohlene L1-Themen | Empfohlene L2-Themen |

|---|---|---|

< 100 | 5 – 10 | 2 – 4 pro L1 |

100 – 500 | 10 – 20 | 3 – 6 pro L1 |

500 | 15 – 30 | 5 – 10 pro L1 |

Wann 1 Ebene vs. 2 Ebenen verwenden?

Kriterium | 1 Ebene | 2 Ebenen |

|---|---|---|

Schnelles exploratives Ziel | ✅ | |

Erste Datenanalyse | ✅ | |

Feine Granularität erforderlich | ✅ | |

Lange und detaillierte Verbatims | ✅ | |

Kurze Verbatims (< 20 Wörter) | ✅ |